StableDiffusionWebUI:细节修复(ADetailer)

【前言】

有时候sd生成的图片细节会有问题,比如脸部或者手部,

常见的方案是给一些负向提示词,和高质量的正向提示词,

但在一些场景下还是有问题。

【场景】

上面说的有问题场景,比如提示词给了full body,

sd就会将精力多分一些给全身,导致脸部效果一般,

即使给了很多高质量正向提示词,和负向提示词embeddings,

正向提示词

(best quality:1), (high quality:1), detailed/(extreme, highly, ultra/), realistic, 1girl/(beautiful, delicate, perfect/), full body

负向提示词

VeryBadImageNegative_V1.3 NG_DeepNegative_V1_75T NegativeHand FastNegative_V2 EasyNegative BadPrompt_V2 BadHand_V4 BadDream, (worst quality:1), (low quality:1), (normal quality:1), lowres, signature, blurry, watermark, duplicate, bad link, plump, bad anatomy, extra arms, extra digits, missing finger, bad hands, bad feet, deformed, error, mutation, text

checkpoint

majicmixRealistic_v7.safetensors

采样器

DPM++ 2M SDE Heun

迭代步数

20

随机种子

402612351

效果

【adetailer】

adetailer可以解决这个问题,

adetailer地址: https://github.com/Bing-su/adetailer

安装后会自动从外网下载一些需要的模型到本地models/adetailer

使用

启动adetailer,模型使用face full

过程

其他参数保持不变,再次生成,

可以看到在生成图片后,会自动识别脸部,

对两部进行二次优化,

效果

可以看到脸部效果好多了

【并行修复】

可以看到上面的效果中手部不是很理想,

adetailer支持并行修复,

在第二个单元中选择手部模型,hand_yolov8n.pt,其他参数保持不变,

再次生成,可以看到这次生成后,检测了脸部和手部,效果也好多了,

但其实adetailer最在行的还是脸部修复

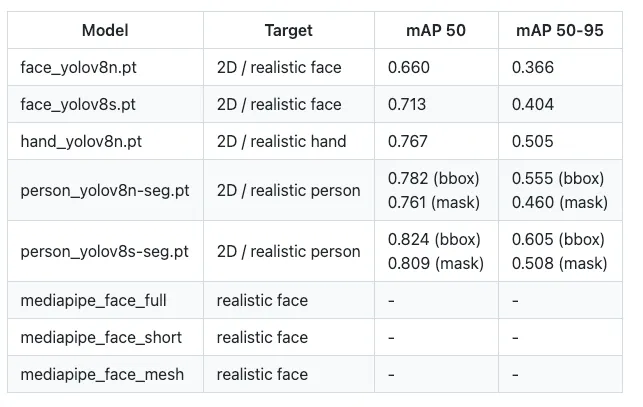

【模型对比】

保持上面参数不变,对比一下,各个模型的效果

mediapipe_face_full

mediapipe_face_short

mediapipe_face_mesh

mediapipe_face_mesh_eyes_only

person_yolov8s-seg.pt

person_yolov8n-seg.pt

face_yolov8s.pt

face_yolov8n_v2.pt

face_yolov8n.pt

目前看着效果差不多,官网上有各个模型擅长的介绍,

【总结】

adetailer是修复脸部细节的强大工具~

SDWebUI

|—地址:https://sdwebui.ai/?from=vq

|—原汁原味的Stable Diffusion WebUI V1.10.1~

|—顶配4090显卡,高级会员独占4090单卡生图~

|—支持Mac客户端,Windows客户端,Web在线使用~

|—独创模型秒传功能,本地模型秒传使用~

|—支持文生图,图生图,附加功能,图片信息

|—支持Clip反推,DeepBooru反推

|—支持高清放大(Hires.fix),内置所需21款放大模型

|—支持细节修复(ADetailer),内置所需11款修复模型

|—支持Controlnet,内置44款预处理器,内置68款所需模型

|—支持超清放大(Tiled Diffusion, Demo Fusion, Tiled VAE)

|—支持老旧照片修复,内置21款放大模型,以及GFPGAN,CodeFormer修复模型

|—内置2个常用Style,11款热门Checkpoint模型,7款热门LoRA模型,14款常见embeddings

|—内置oldsix提示词插件

|—内置23讲新手入门教程

相关推荐

StableDiffusionWebUI:Checkpoint

【前言】 sd的生图离不开checkpoint, 最初官方提供了一些checkpoint, 后续sd爱好者自己训了很多checkpoint, 可以在huggingface或者civitai上找到。 【Checkpoint使用】 安装 下载checkpoint后,放到stablediffusionwe

StableDiffusionWebUI:Embeddings

【前言】 embeddings,text inversion都指文本嵌入, 可以简单理解为一组提示词的集合, 负向,正向提示词都会用到。 【Embeddings使用】 安装 下载embeddings后,放在stablediffusionwebui/embeddings下即可 使用 在embeddin

StableDiffusionWebUI:文件介绍

【前言】 本节介绍sdwebui文件结构, https://github.com/AUTOMATIC1111/stablediffusionwebui 【文件结构】 configs:配置文件 embeddings:embeddings文件 extensionsbuiltin:内置插件 extensi

StableDiffusionWebUI:旧照片修复(GFPGAN)

【前言】 sdwebui的应用场景之一就是旧照片修复, 其实目前常见的旧照片修复在sdwebui前就有了, GFPGAN: https://github.com/TencentARC/GFPGAN CodeFormer: https://github.com/sczhou/CodeFormer 但是

StableDiffusionWebUI:界面介绍

【前言】 前面几章介绍了sd安装,本章介绍一下sdwebui的界面 【简介】 从上往下依次包括: 模型选择区:选择checkpoint模型,以及本地添加模型后刷新 主功能tab:切换各种常见的功能,例如文生图,图生图,pnginfo 提示词区:输入正向负向提示词 生图参数区:调整各种生图参数 图片预

StableDiffusionWebUI:高分辨率修复(Hires.fix)-重绘幅度

【前言】 上一节介绍了Hires.fix的算法区别, https://blog.vincentqiao.com/sdhiresfixm 本节介绍下Hires.fix的重绘幅度。 【Hires.fix】 还是固定其他与参数进行对比, 提示词中文 一个男孩,坐在椅子上,上半身,靠近窗口,蓝色上衣,黑色头

StableDiffusionWebUI:高分辨率修复(Hires.fix)-算法

【前言】 SD默认生成的图片是512x512的, 首次生图设置宽高太大,可能会有意想不到的问题, 建议还是首次512x512生图,然后后期通过高清放大提升分辨率。 高清放大有很多种方法,本节介绍高分辨率修复(Hires.fix) 【Hires.fix】 Hires.fix中的放大倍率,宽度,高度调整

StableDiffusionWebUI:Linux安装

【前言】 上一节讲了mac如何安装stable diffusion, StableDiffusionWebUI:Mac安装 linux的安装也大同小异, 本节介绍下sd在linux上的安装。 【服务器】 由于整个安装过程中需要安装很多依赖, 建议使用香港的竞价GPU服务器来安装, 安装好后打一个服务

StableDiffusionWebUI:Mac安装

【前言】 目前aigc生图赛道常见的几种方案, 1.sd生图 2.midjourney生图, https://www.midjourney.com/home 3.其他大模型生图 从几个维度简单对比一下 【sd简介】 github上sd相关项目有3个 https://github.com/CompVi

StableDiffusionWebUI:LoRA

【前言】 如果说checkpoint决定你生图的主要效果和风格, embeddings主要是负向提示词,避免不好的效果, 那lora就是微调,出你想要的效果。 【LoRA使用】 安装 将下载的LoRA添加到stablediffusionwebui/models/Lora即可, 如果不显示,点击右侧的

StableDiffusionWebUI:图片信息(PNG Info)

【前言】 png info是sdwebui自带的一个小功能, 在日常生图过程中必不可少。 【PNG Info】 简单说就是上传一张图片, 读取图片的meta信息, 解析出其中的生图信息, 并可以方便的回传到其他功能, 例如文生图,图生图,局部重绘等。 使用也比较简单,在PNG Info的tab, 上

StableDiffusionWebUI:提示词插件

【前言】 本地安装sdwebui,及简单认识了sdwebu的界面后, 可能就陷入了迷茫,到底应该怎么生图? 其实可以先设定几个小目标: 1.找到自己喜欢的ip,或者动漫,或者明星等,尝试生成ip图片 2.尝试个自己普通的照片,换为酷炫的场景 【提示词】 例如我想生成一张鸣人成为火影后的图片, 那就需

StableDiffusionWebUI:采样器(Sampler)

【前言】 本章介绍sdwebui中的采样器 【采样器】 采样器,sampler是SD图像生成过程的采样方法, 以下面一段提示词,文生图,固定checkpoint,固定随机种子,对比不同采样器效果 提示词中文 一个男孩,坐在椅子上,上半身,靠近窗口,蓝色上衣,黑色头发,戴眼镜,面向镜头,左手边是窗子

StableDiffusionWebUI:启动参数

【前言】 sdwebui启动时会有很多参数,本文依次分析一下 【启动参数】 启动参数的解析位于modules/cmd\args.py下 \f:允许root用户启动 \updateallextensions:启动时更新所有插件 \skippythonversioncheck:跳过python版本号检查

StableDiffusionWebUI:迭代步数(Steps)

【前言】 本节介绍sdwebui中的采样迭代步数, 【采样迭代步数】 上一节介绍了采样器: https://blog.vincentqiao.com/sdsampler 采样迭代步数是指生图过程中添加噪声和降噪的步数 提示词中文 一个男孩,坐在椅子上,上半身,靠近窗口,蓝色上衣,黑色头发,戴眼镜,面

sdwebui.ai-即开即用原生sdwebui

sdwebui.ai sdwebui.ai是即开即用的原生在线sdwebui,地址:https://www.sdwebui.ai/ 原汁原味的Stable Diffusion WebUI V1.10.1 顶配4090显卡,高级会员独占4090单卡生图 支持Mac客户端,Windows客户端,Web在

SodaArt-三步修复老旧照片

环境准备 打开 https://sodaart.ai/ , 下载mac或windows客户端,本地安装后打开, 或者点在线生图直接打开web端, 步骤1:登录首页 使用手机号+验证码,登录首页,点击在线生图, 步骤2:在附加功能上传老旧照片 在线生图附加功能tab下,上传自己的老旧照片, 步骤3:配